Алгоритъмът посочи датата на смъртта ми, приписа ми постижения и роднини, които нямам, разказва д-р Винт Сърф – главен интернет евангелист на "Гугъл"

„Реших да тествам един чатбот и го помолих да ми напише некролог. Знам, че звучи ужасно, но си помислих: форматът за писане на некролог вече е усвоен от големите езикови модели, които генеративният изкуствен интелект (AI) използва, има много некролози в интернет, хора умират всеки ден, други пишат за това. Може би има и някаква информация за мен – най-малкото в Уикипедия. Значи за чатбота няма да е кой знае какъв проблем да напише разумен некролог. И той наистина го написа. Както бихте очаквали, там имаше нещо такова: „Съжаляваме да съобщим, че доктор Сърф почина." Имаше и дата. Макар че беше в бъдещето, това ме разстрои, разбира се. После обобщаваше кариерата ми, след това добавяше списък с членове на семейството ми. Забелязах обаче, че се пообърка. Пишеше, че съм направил неща, които бяха заслуга на други, а сред членовете на семейството ми имаше имена на роднини, каквито нямам."

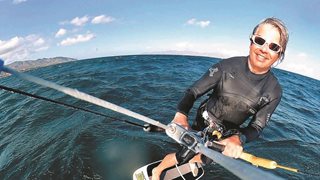

Д-р Винт Сърф – един от бащите на интернет, искрено се забавлява, когато разказва своите приключения с изкуствения интелект на няколко журналисти на Форума на лауреатите в Хайделберг през 2023 г.

Разказът му звучи къде иронично, къде сериозно, но идеята е ясна – изкуственият интелект, който ударно завладява света и не слиза от медийните страници в последните години, е нещо по-сложно, непредвидимо и многопластово, отколкото мнозина предполагат.

„Многопластово" може да не е първата, но поне една от думите, които хрумват на човек, който има любопитството да се гмурне в дебрите на AI. По-вероятно първата дума да е друга – „полезно". Изкуственият интелект вече ни отменя в създаването и превеждането на текстове, в превръщането им в реч и обратно, в почистването и затоплянето на домовете ни, скоро може да ни отмени и в карането на коли. Тази мощна технология може да прави (почти) всичко – от текст и изображение до аудио и видео.

Но както винаги, и тук освен добра има и лоша новина – това мило и полезно нещо, което е готово да генерира всичко, което му поръчаш, или да помогне тутакси,

когато му възложиш задача, се оказва

нещо средно между добре възпитано дете и скрит хулиган –

разрушителна мина и дремещ вулкан от клопки, рискове и последици едновременно, за които малцина се замислят. Ако реши, генеративният AI може да ви „снима" на места, на които не сте били никога, и да вкара в устата ви думи, които не сте изричали. И това е най-малкото, което може да ви се случи...

Когато едно пораснало дете се държи зле със света, върши безобразия и най-общо казано излага родителите си пред хората, обикновено казваме, че му липсват първите 7 години.

Много често на изкуствения интелект му липсват доста по-малко от 7 години. Така нареченото машинно обучение, което преминава всеки изкуствен интелект, рядко се радва на лукса да продължава 7 г. То става все по-бързо и по-бързо главно заради огромните бази данни, с които разполагат разработчиците от потока на информация, която ни залива.

Д-р Винт Сърф признава, че не е експерт в тази област,

но предполага, че

„обучението" на един чатбот става по начин, подобен на училищното

Там винаги има обратна връзка от страна на човек – учителя – а механизмът е прост – създават се връзки между отделните елементи, а учителят подсилва това, което изглежда по-необходимо.

В случая с чатбота материалът, необходим за обучението му, се натрупва под формата на фрази и думи. После, в зависимост от това колко често те взаимодействат помежду си в реалния живот, се изгражда гигантска сложна мрежа, която отразява взаимоотношения между тях.

„Това не е многопо-различно от онази част в обучението, когато на децата се дават думи или фрази, в които да попълнят празната буква или дума. После учителят оценява колко добре детето е попълнило празното място. Докато оценява как се справя детето отново и отново, се получават връзки и параметри, които определят как трябва да изглежда крайният резултат", обяснава бащата на интернет.

„Техниката е малко като обучение на куче – прави друга аналогия Андрей Михай от онлайн магазина за наука ZME Science – давате на алгоритъма „лакомства", когато се справя добре, но когато прави нещо, което не искате да прави, му ги отказвате". Така хората помагат на алгоритъма и оформят поведението му.

Дотук – добре. Бедата идва, когато моделите за машинно обучение на генеративния изкуствен интелект, какъвто са чатботовете, губят контекст. „Те не знаят откъде идват всички фрази, които чатботът използва, за да създаде текст. Те не знаят, че една фраза идва от едно място, а друга – от различно. Много често единственото нещо, което ги свързва, е, че са били на една и съща уебстраница, нищо повече. Но чатботът не знае това и ги смесва. Той не знае, че е имало контекст, за да ги раздели", казва д-р Сърф. Затова според него трябва да работим големите модели за обучение да знаят повече за контекста на данните, които използват.

Малцина всъщност са наясно, че ChatGPT, който набра невероятна скорост от 30 ноември 2022 г., когато бе обявен, е обучаван с данни до 2021 г. Затова по-добре не го питайте за събития, които са се случили след това – той просто има много ограничени познания за тях.

Вече сте разбрали – изкуственият интелект не е нищо друго освен

алгоритъм, разработен, като са използвани огромни бази данни

колкото повече, толкова по-добре. Малцина обаче си задават въпроса как работи този алгоритъм, кой го е обучил, какви данни са използвани при това обучение?

Колкото по-голям набор от данни се използва за машинното обучение, колкото тези данни са по-разнообразни и представителни, толкова по-вероятно е да се създадат алгоритми, които са безпристрастни и етични, не поддържат вредни стереотипи или не дискриминират определени групи, а шансът за грешки на изкуствения интелект намалява, обяснява Михай.

И обратно – ако наборът от данни е ограничен, ако е свързан – съзнателно или не – с определени групи, алгоритъмът може да бъде тенденциозен, дори по-лошо – дискриминиращ. Ако един алгоритъм е обучен с набори от данни, съставени предимно от бели мъже, той може неволно да дискриминира жените и цветнокожите, дава пример Михай. Затова той нарича AI „Кутията на Пандора".

Коментари (0)

Вашият коментар